Google a développé mod_pagespeed, un nouveau module pour Apache permettant d'optimiser les ressources du serveur, une nouvelle possibilité pour accélérer la vitesse de son site. Voici la liste de ses fonctionnalités et un retour d'expérience.

Les dossiers de WebRankInfo

+ de 1000 articles Digital Marketing complets, détaillés, rédigés en grande partie par Olivier Duffez (consultant SEO, créateur du site). Ils couvrent essentiellement le référencement naturel (SEO) et particulièrement Google, mais aussi Google Analytics, Google AdWords, les réseaux sociaux, l'administration d'un site web, etc.

Début mai, Google a mis en ligne une modification de son algorithme de référencement naturel, comme plusieurs centaines de fois par an. Mais cette fois-ci le changement a été fortement ressenti par de nombreux webmasters et emarketers. Certains ont connu une baisse soudaine de près de 20% et bien entendu d'autres ont au contraire bénéficié de fortes augmentation de trafic. Vous trouverez dans cet article des explications sur ces changements d'algo de Google, qui devraient avoir un impact assez fort dans les mois et années à venir, notamment sur l'optimisation de la longue traîne (Long Tail).

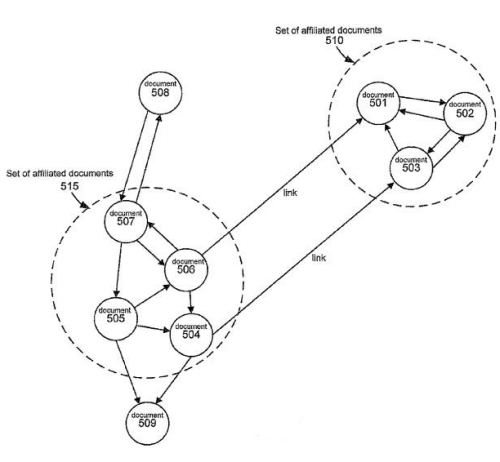

Google pourrait tenir compte des relations entre les sites pour le poids des backlinks

On le sait déjà depuis longtemps, l'époque où la simple formule mathématique du PageRank régissait la partie off-page du référencement Google est dépassée. De nombreuses autres caractéristiques des liens sont prises en compte, comme je le détaille dans mon guide du netlinking (position du lien dans la page, nofollow, etc.). Google a obtenu en août 2010 un brevet intitulé Determining quality of linked documents, attribué à 3 de ses plus grands ingénieurs. Dans l'analyse de l'apport des backlinks pour le référencement d'un site, leur système tient compte des relations entre les sites. En résumé, mieux vaut obtenir des liens depuis des sites avec lesquels vous n'avez aucun rapport (hormis la thématique éventuellement) plutôt que vos autres sites ou ceux de vos amis. Explications...

Voici un petit quiz de référencement naturel orienté R&D, algorithmes des moteurs de recherche, information retrieval. Saurez-vous répondre correctement à toutes les questions ? Attention c'est loin d'être facile...

Une fois de plus Google fait parler de lui en modifiant son logo, cette fois-ci avec une version animée assez sophistiquée.

Connaissez-vous YouTube Movies, une nouvelle rubrique du portail vidéo proposant pas moins de 400 des films longs métrages gratuits ?

Parmi les nombreuses extensions Firefox d'aide au référencement, SEO Quake figure en bonne place depuis déjà longtemps. Voici donc un tutoriel SeoQuake très complet...

Cet article présente les principaux systèmes de gestion du cache des données, aussi bien au niveau de MySQL et PHP que du serveur web, et même d'autres possibilités de mise en cache supplémentaires par la programmation. Ce dossier a été entièrement préparé et rédigé par Fandeciné, éminent membre-modérateur du forum WebRankInfo.

Sur les principaux moteurs, il est possible d'effectuer des requêtes complexes, par exemple pour chercher les pages web ayant certains mots dans certaines zones de la page (titre, URL, etc.). Voici la liste des commandes de recherche avancée pour Bing, le moteur de Microsoft.

Jusqu'à présent, le nom officiel du robot du moteur de recherche de Microsoft n'a pas évolué aussi rapidement que les noms du moteur : il s'appelle toujours msnbot, du nom de MSN Search, l'ancêtre de Live Search, celui-là même qui a engendré l'actuel Bing :-) A partir du 1er octobre 2010 le nom d'agent sera donc Bingbot.

Connue sous le nom de code Caffeine, la nouvelle infrastructure technique de Google est officiellement en place. Comme je l'ai déjà répété à plusieurs reprises, il s'agit surtout de changements internes chez Google qui concernent majoritairement le crawl et l'indexation (la fraîcheur de l'index serait améliorée de 50%). C'est donc seulement de façon indirecte que nous sommes concernés, pas en tant que changement d'algorithme (comme récemment avec May Day).

Brevet de Google : l'indexation basée sur l'analyse des syntagmes

Google vient d'obtenir un (nouveau) brevet sur l'indexation basée sur l'analyse des extraits de phrases. Cette méthode, basée sur les syntagmes, apporte quelques nouveautés dans l'indexation des pages web.

Après le traitement des mots, Google en vient à celui des groupes de mots (bientôt la phrase ?). Il ne s'intéresse pas à proprement parler à la syntaxe (la construction de la phrase type sujet, verbe et complément) mais à la phraséologie c'est à dire à la modélisation de groupes de mots, à la relation des mots qui sont associés dans une requête ou dans un document.

En collaboration avec LG, Google s'apprête à lancer un frigo américain connecté à Internet. Disposant d'un vaste écran sur la façade, il facilite toute la gestion des approvisionnements en tenant à jour tout le contenu du frigo. Des alertes se déclenchent dès qu'une denrée stratégique vient à manquer. Bien entendu vous pouvez refaire le plein en validant votre liste de courses en 1 clic et sans quitter votre cuisine.

Il vous est peut-être déjà arrivé d'avoir un grand nombre de pages sur votre site qui disparaissent et génèrent donc des erreurs 404 (Page introuvable). Est-ce nuisible pour votre visibilité dans Google ? A priori non... explications !

Mon extension Firefox favorite vient tout juste d'être réécrite par son auteur Chris Pederick en version adaptée à Google Chrome. Y a-t-il désormais suffisamment d'extensions adaptées au référencement pour basculer de Firefox à Chrome ? A mon avis il manque encore quelques outils, on en reparlera prochainement.

Comment se défaire d'une mauvaise réputation sur les réseaux sociaux et Internet ?

Si vous êtes victime d'une atteinte à votre réputation sur Internet, que devez-vous faire pour faire respecter vos droits ? Voici la réponse de Maitre Cahen, avocate à la Cour d'Appel de Paris.

Pubsubhubbub est un protocole open source destiné à faciliter les abonnements aux flux RSS/Atom, permettant aux abonnés d'être notifiés en quasi temps réel de l'arrivée de nouveaux éléments, tout en réduisant la charge des éditeurs hébergeant ces flux. Développé par Brad Fitzpatrick, Brett Slatkin et Mihai Parparita, 3 ingénieurs de Google, Pubsubhubbub est déployé progressivement sur un grand nombre de produits Google. Wordpress le propose via un plugin, et vous, allez-vous l'adopter ? Cet article vous explique tout !

Extensions Chrome pour le web sémantique (RDF, XFN, microformats, meta)

Voici 3 extensions Chrome qui pourraient vous aider si vous vous intéressez au web sémantique (ou à ses balbutiements si vous préférez).

Ce tutoriel explique comment créer un compte @yandex.ru pour accéder aux outils destinés aux webmasters, puis comment ajouter un site. Enfin il détail quelques fonctionnalités inédites de Yandex.

Cet article fournit des conseils d'optimisation du référencement pour Yandex. Parmi les notions abordées : l'index TIC, la géolocalisation, la linguistique, le contenu dupliqué, les SERP Yandex, les robots, l'URL rewriting et des ressources SEO sur Yandex.

Cet article constitue la première partie du tour d'horizon consacré au principal moteur de recherche russe : Yandex. Il présente son histoire, des années 1990 à nos jours.

Depuis 2009, Google permet de définir des URL canoniques entre plusieurs sites, ce qui peut être dans certains cas particuliers une solution au duplicate content externe.

Jusqu'à présent, Google ne personnalisait les résultats (en fonction de l'historique des recherches de l'utilisateur) qu'à la double condition qu'à la création de son compte Google, l'utilisateur ait coché la case autorisant Google à conserver cet historique, et qu'il soit connecté à ce compte pour effectuer ses recherches. Désormais Google personnalise les SERP pour tout le monde. Autant dire que ça va modifier quelques habitudes chez les référenceurs...

Google vient d'annoncer quelques nouvelles fonctionnalités dans Google Maps, permettant d'effectuer des recherches de biens immobiliers. Ca n'a l'air de rien pour les internautes mais je ne pense pas que ça plaise vraiment aux portails immobiliers... Petit à petit, Google propose tellement de possibilités de recherches sur ses services que l'internaute risque de prendre l'habitude de venir sur Google quel que soit le motif de sa recherche, plutôt que d'aller sur des sites spécialisés.

Paru en janvier 2009 sous le titre original What Would Google Do?, ce livre est sans aucun doute un des livres à avoir lu en ce moment ! Tous ceux qui baignent dans Internet aussi bien sur le plan professionnel que personnel devraient le lire, au moins pour réfléchir aux profonds changements apportés par l'économie numérique.

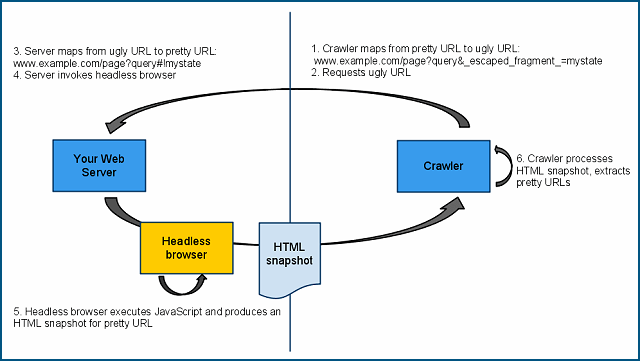

Le référencement d'un site en AJAX est en général aussi compliqué (voire plus) que celui d'un site en Flash... Bref, si AJAX sert à accéder au contenu du site, il vaut mieux éviter ces technologies si on veut qu'il soit vraiment bien référencé (ou alors tout est plus compliqué). Google vient de faire une proposition de solution technique permettant l'indexation de sites en AJAX. Nous verrons si d'autres moteurs suivent Google dans cette voie et si les développeurs apprécient l'idée de Google. Voici quelques premières explications...

Le cloaking est une technique qui consiste à configurer un site web pour que le contenu d'une page diffère selon le type d'utilisateur qui cherche à la consulter. Les moteurs interdisent cette pratique dès lors que le contenu fourni aux robots est différent de celui fourni aux internautes. Voici quelques cas particuliers commentés par Google...

Depuis le lancement de Bing le 1er Juin 2009, vous cherchez peut-être à améliorer le référencement de votre site sur Bing Search, le nouveau moteur de recherche de Microsoft. Pour compléter les premiers conseils aux webmasters pour Bing, voici un premier guide du référencement sur Bing. Il est issu pour l'instant essentiellement des conseils officiels de Microsoft, mais il sera complété par la suite. Bonne lecture !

Interview d'Ambroise Fensterbank de l'équipe qualité de Google

J'ai eu l'occasion de pouvoir interviewer Ambroise Fensterbank qui travaille depuis un peu plus de 2 ans dans l'équipe en charge de la qualité de l'index de Google, pour la partie francophone. Nous avons abordé un certain nombre de questions sur les problèmes des sites multilingues et sur l'algorithme en général : utilisation de données issues de l'analyse du comportement de l'internaute, gestion des lettres accentuées, l'inefficacité de l'indice de densité ou encore la dénonciation du spam... Bonne lecture !

Google change sa gestion des liens nofollow : la fin du PR sculpting

Google vient de lâcher une info qui fait grand bruit depuis plusieurs jours, mais qui ne me semble pas exprimée assez clairement pour que l'on sache vraiment quoi conclure. D'ailleurs certains ont réagi un peu trop rapidement il me semble, annonçant la fin de la prise en compte par Google des liens nofollow... D'après ce que Matt Cutts aurait annoncé, la popularité qu'une page peut transmettre serait désormais fonction du nombre total de liens sortants (follow + nofollow) alors que jusqu'à présent elle dépendait du nombre de liens follow. Dit autrement, ajouter des liens nofollow sur une page gaspille de la popularité à distribuer alors qu'avant elle l'économisait. C'est donc sans doute la fin du PageRank sculpting basé sur l'attribut nofollow. Cet article tente d'y voir plus clair avec un certain nombre d'explications et d'exemples...

La semaine dernière fut riche en annonces fracassantes de la part de Google : en plus du changement de politique pour les liens nofollow (j'y reviendrai), c'est du côté des liens JavaScript qu'il y a du nouveau. Comme je l'indiquais en direct pendant la formation au netlinking à Paris, nous avions remarqué depuis décembre 2008 dans notre laboratoire Ranking Metrics des robots spécifiques de Google qui tenaient compte de certains codes JavaScript (dont l'événement onClick). Il semblerait que cela soit désormais répandu... Revue de détails dans cet article.

Voici un récapitulatif sur Bing, le moteur de recherche de Microsoft qui succède à Live Search. Ce guide vous aidera à faire indexer votre site sur Bing, à mieux comprendre son fonctionnement et à vous tenir informé des évolutions de Bing. Bonne lecture !

Les Rich Snippets de Google, basés sur l'analyse des données web structurées

Depuis le temps que les spécialistes du secteur se demandaient pourquoi Google n'exploitait pas plus les données structurées ! Google vient d'annoncer qu'ils allaient utiliser les 2 principaux formats de marquage de données structurées (les microformats et le standard RDFa) pour afficher certains résultats de manière enrichie : note moyenne et nombre d'avis par les consommateurs, adresse d'une entreprise, etc. Un petit pas vers le web sémantique... Cet article détaille tout cela et explique comment les webmasters doivent mettre à jour leurs sites pour en tirer profit.

Les recherches locales sont de plus en plus nombreuses et Google les met de plus en plus en avant. Il est donc désormais stratégique d'optimiser son référencement local ! Une des choses à mettre en place pour mener cela à bien est d'analyser correctement le trafic local, c'est-à-dire celui généré par Google Maps et la recherche universelle. Voici un article qui vous explique les bases du tracking de Google Maps dans Google Analytics.

... ou les relations particulières de Google avec le chant et le canard !

Après l'introduction du lexème et du morphème grâce à la pomme de terre, je vous propose aujourd'hui de continuer notre découverte des aspects linguistiques des moteurs de recherche grâce au canard et au sème !

Cet article est rédigé selon la même approche que le précédent, il ne prétend pas être exhaustif sur la question ni s'adresser à des spécialistes du langage ou de linguistique informatique. Il s'agit d'un kit de survie linguistique à l'usage du référencement ;-)

... ou les relations particulières de Google avec la pomme de terre et l'indice de densité !

Reconnaître un mot écrit pour tout lecteur va de soi mais comment un robot fait-il pour "lire", c'est-à-dire identifier et traiter ce fameux mot ? Pour vous, c'est évident, vous en lisez et en écrivez tous les jours, vous les repérez sans même vous en rendre-compte mais un moteur, un robot, comment fait-il ? A-t-il simplement avalé un dictionnaire ? Ceux qui ont participé à ma formation le savent déjà, pour les autres voici un petit aperçu des traitements linguistiques sur la question...

En plus des mesures controversées de restriction d'accès à Internet (HADOPI), la Loi Création et Internet votée le 2 avril 2009 définit le nouveau statut d'éditeur de presse en ligne. Les éditeurs web qui choisiront ce statut pourront bénéficier de conditions assez proches de celles de la presse écrite, ce qui permettra peut-être de dynamiser un secteur en pleine évolution.

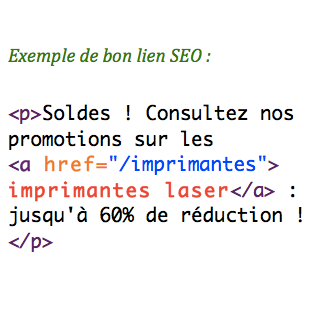

Google tient compte des mots-clés dans l'URL, mais leur impact est moins fort que vous le pensez

Conseils d'optimisation des URL pour le référencement : quelle est l'importance réelle de la présence de mots-clés dans l'URL ? Explications par Olivier Duffez.

Les comptes et vues sont bien souvent mal compris et utilisés dans Google Analytics. Il est pourtant très important de bien savoir comment les exploiter car ils sont à la base de l'organisation des données, des filtres et autres objectifs... En formation Google Analytics, nous abordons bien entendu la question des comptes et des vues Google Analytics. Voici en tout cas un article pour faire le point.

Certains sites utilisent encore des adresses sans nom de domaine propre, utilisant les services (gratuits) d'un fournisseur d'accès ou d'une plateforme de blogs, forums, wiki, etc. Pour le référencement c'est parfois la catastrophe car l'adresse du site peut changer plusieurs fois, selon les humeurs du prestataire. Voici un exemple et quelques explications...

Dans Search Console, vous pouvez choisir de paramétrer des options pour la fréquence des visites du robot Googlebot pour qu'il vienne plus ou moins souvent sur votre site, en fonction de la charge du serveur.

L'infrastructure technique impressionnante de Google est certainement un des éléments clés de sa réussite d'une part, et des difficultés des concurrents pour le rattraper. The Economist estime aujourd'hui à 2 millions le nombre de serveurs utilisés par Google dans ses différents data centers.

Si vous avez un site web avec des objectifs bien définis, vous vous posez sans doute des questions sur la performance des actions de conversion de votre site. Dans un monde parfait, les internautes connaissent bien votre site, sa navigation ainsi que les produits et services proposés. Ils savent donc où aller pour effectuer une transaction. Par transaction, je parle d'interactivité web au sens large, c'est à dire de la conversation engagée entre vous et vos visiteurs via les actions de conversion de votre site web. Cet article a pour but de vous présenter les principes d'optimisation du taux de conversion, ce qui est très efficace pour doper vos ventes pour Noël...

La proéminence d'un mot est une mesure de sa distance relative par rapport au début du texte. Elle s'exprime sous la forme d'un pourcentage qui est d'autant plus élevé que le mot est placé au début du texte. Il semble bien que la proéminence fasse partie des critères d'analyse on page utilisés par Google (et par d'autres moteurs). Il est donc important d'essayer dans la mesure du possible de positionner les mots les plus stratégiques d'une page plutôt vers le début.

A l'occasion des journées de formation aux Web Analytics organisées par Ranking Metrics, je démarre sur WebRankInfo une série d'articles consacrés aux Web Analytics. J'ai en effet observé que de nombreuses personnes n'exploitent qu'une très faible partie des fonctionnalités des outils d'analyse d'audience, ne se rendant pas compte que ces outils peuvent aider à augmenter le chiffre d'affaires d'un site... Ce premier article explique comment faire pour que Google Analytics ne tienne pas compte de son propre trafic, c'est-à-dire de toutes les pages que l'on consulte sur son propre site web.

Gestion singulier/pluriel dans le référencement (algo Google)

Comment les moteurs de recherche tiennent-ils compte des différentes formes d'un mot (singulier/pluriel) ? Nous savons bien que les moteurs repèrent la racine commune du mot (stemming), si bien qu'en utilisant le singulier sur une page, on peut bien sortir dans les résultats pour une requête au pluriel (et réciproquement). L'attribution d'un brevet sur la question à Yahoo est l'occasion de revenir sur ce sujet d'étude du référencement...

A l'origine un terme utilisé uniquement par quelques fans de Google, parmi les webmasters passionnés de référencement et les référenceurs professionnels, la Google Dance était début 2000 un événement incontournable des SEO. Il a désormais disparu, en voici l'historique.

Cet article présente la notion de blacklistage (blacklisting) de Google et indique ce qu'il faut faire si votre site est ainsi banni de l'index Google.

Pour indexer des millions de pages tous les jours, Google utilise une "armée" de robots d'indexation, appelés GoogleBot (lire l'étude sur GoogleBot pour en savoir plus). A chaque fois qu'un de ces robots visite une page, il la récupère et la stocke sur un des serveurs de Google. Cette version du document est appelée la version cache. On comprend vite qu'avec des milliards de documents Google ait besoin de plus de 10 000 serveurs (et beaucoup de disques durs...).

Les milliers de serveurs de Google sont répartis sur des centres de données, appelés Data Centers. Voici la liste des premiers data centers de Google...

Cet article présente la société Google, de sa naissance en 1998 à nos jours...

Tout le monde s'enthousiasme pour le dernier né de la grande famille Google, à savoir le navigateur web Google Chrome. Certains vont quand même trouver des bonnes raisons de détester Google Chrome ! Voici pourquoi je ne vais pas (encore) basculer vers ce navigateur...

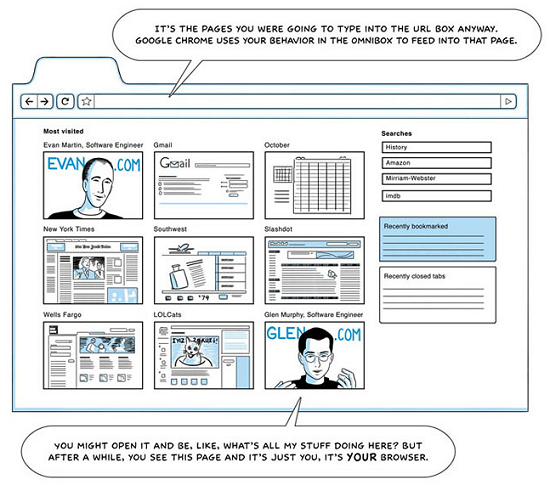

Après d'éternelles rumeurs (on parlait de GBrowser il y a 4 ans), voilà qui devient officiel : Google se lance dans la guerre des navigateurs web avec Google Chrome. Il s'agit d'un logiciel open source basé sur Webkit, le moteur qui propulse Safari, le navigateur maison d'Apple. Que va en penser Mozilla, qui vient tout juste de renouveler son partenariat avec Google ? Et surtout Microsoft, qui a vu la part de marché de son navigateur Windows Explorer chuter depuis l'arrivée de Firefox ? Quels sont les réels objectifs de Google avec son nouveau navigateur Google Chrome ?

Priyank Garg, directeur de Yahoo Search, répond aux questions d'Eric Enge à propos de l'importance des liens dans l'algorithme de Yahoo Search, de la politique de Yahoo concernant l'achat et la vente de liens, de la lutte contre le spamdexing, les balises meta robots noindex et nofollow, et enfin de la classe robots-nocontent...

Utiliser PHP sur son site pose-t-il un problème pour le référencement ? Cet article explique que ce n'est pas le cas et donne quelques conseils associés.

Le netlinking (stratégies de liens) est sans aucun doute le nerf de la guerre du référencement, mais tous les backlinks ne se valent pas... Cet article passe en revue les critères qui permettent d'évaluer la qualité d'un backlink pour le référencement.

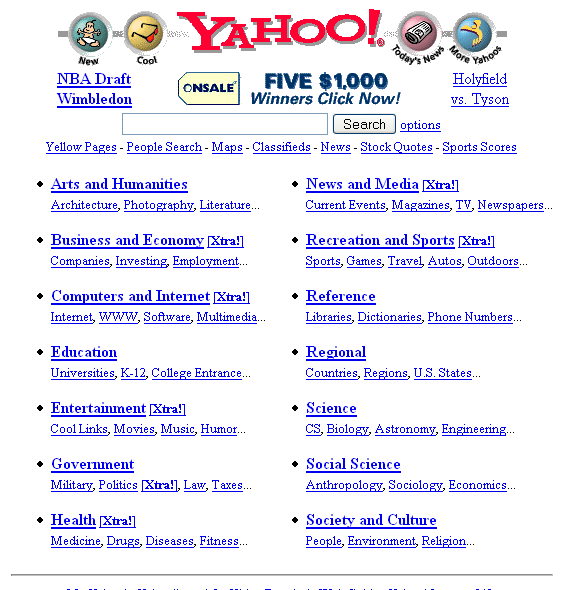

L'annuaire Yahoo!, créé en 1994, a fermé définitivement fin 2014

Yahoo!, créateur de l'annuaire le plus célèbre d'Internet, l'a finalement supprimé le 31/12/2014, après 20 ans de services... Cet article rappelle ce qu'a été l'annuaire Yahoo et le rôle qu'il a joué dans le référencement.

Il existe plusieurs cas pour lesquels des redirections doivent être utilisées (renommage d'un fichier, changement d'adresse du site, lien...). Du point de vue du référencement, parmi toutes les méthodes de redirection, certaines sont plus recommandées que d'autres, comme nous l'expliquons ci-dessous. Du point de vue de l'internaute, c'est en général plus simple car il suffit de trouver un moyen d'afficher la page redirigée : il ne sera pas sensible au type de redirection.

Obtenir des liens est essentiel, mais il est souvent indispensable de faire des liens externes (vers d'autres sites). On distingue plusieurs motivations :

Un site a retenu votre attention, vous estimez qu'il mérite d'être connu et vous faites un lien vers lui : c'est le lien naturel, celui sur lequel s'appuie l'algorithme du PageRank (pour lequel un lien représente un vote). C'est également celui qui se fait de plus en plus rare, sans doute à cause de Google d'ailleurs...

Vous avez créé un annuaire ou une rubrique "Ressources" : ce sont des liens exhaustifs (ou un best of...)

Vous faites des échanges de liens avec d'autres sites qui cherchent comme vous à améliorer leur popularité (au sens du web).

Quand Google a bâti son algorithme, le moteur de recherche vedette de l'époque, Altavista, ne se basait quasiment que sur le texte d'une page pour juger de sa pertinence pour une requête donnée. Les fondateurs de Google ont bouleversé la donne en se basant également sur des données extérieures à la page. Parmi ces données figure bien entendu le PageRank (pour estimer la popularité de la page sur le web) mais aussi le contexte sémantique issu des liens.

Les trois techniques les plus répandues pour obtenir des liens (et donc améliorer son référencement) sont la création de contenu à forte valeur ajoutée, les échanges de liens et les inscriptions dans les annuaires.

Une page type pour le référencement est assez facile à décrire : il suffit de la composer naturellement telle que vous l'auriez fait si vous ne saviez pas qu'il faut l'optimiser ! Cela peut paraître stupide, mais les meilleures pages sont celles contenant des phrases bien construites, avec bien sûr vos mots-clés. Par contre évitez les listes de mots-clés, cela ne fait pas très sérieux pour le visiteur, et si un robot d'indexation tombe dessus, vous risquez d'être détecté et par conséquent blacklisté !

1 trillion, c'est-à-dire mille milliards (1.000.000.000.000) : voilà le nombre de pages web distinctes que Google a répertorié ! Jesse Alpert et Nissan Hajaj (2 ingénieurs de Google de l'équipe en charge de l'infrastructure de la recherche) donnent quelques chiffres qui donnent le tournis...

Alors que jusqu'à présent les pages accessibles uniquement via un formulaire font partie de ce qu'on appelle le web invisible (des moteurs de recherche), Google a commencé à expérimenter le crawl des formulaires. C'est à la fois une bonne et une mauvaise nouvelle... explications.

Google vient d'annoncer un de ses changements les plus importants depuis son lancement : la recherche universelle (Google Universal Search ou Blended Search). En quelques mots : au lieu d'afficher uniquement des résultats issus de la recherche web classique (des pages web au format texte ou assimilé), Google affiche désormais aussi des résultats issus de ses moteurs de recherche spécialisés (dits verticaux) comme par exemple l'actualité, les images ou les vidéos (et bien d'autres services de recherche Google).

Prise en compte de la mise en page HTML par les moteurs de recherche

Après Microsoft et Google, c'est au tour de Yahoo de faire parler de lui au sujet de l'analyse de la mise en page des sites Internet disséqués par son robot d'indexation. Cet article résume les techniques décrites par ces 3 moteurs de recherche...

A l'occasion de la publication des résultats d'une étude sur le suivi du regard (Eye Tracking ou plus savamment oculométrie), je vous livre ici une petite synthèse de ce qu'il faut connaître à ce sujet. Quel est le rapport avec le référencement ? Savoir comment les internautes lisent à l'écran (notamment les pages de résultats des moteurs) s'avère assez utile...

Le W3C vient de publier une version de travail décrivant la future version du langage HTML : la version 5. Même si on a largement le temps avant qu'elle soit utilisée, voici quelques informations sur ce qui change et surtout l'impact sur le référencement.

Certaines pages web comportent des liens dits nofollow, qui ne sont pas pris en compte par les moteurs de recherche. Si un partenaire de référencement vous fait un lien mais qu'il met l'attribut nofollow, il vaut mieux vous en rendre compte car il ne vous aidera pas du tout (mis à part le trafic) ! Voici comment détecter ce type de lien en modifiant automatiquement leur apparence dans Firefox...

Saviez-vous qu'il est possible de restreindre la recherche d'images dans Google Images pour n'afficher que des visages ? Google travaille actuellement sur la reconnaissance faciale, grâce aux compétences de la société Neven Vision que Google a rachetée en août 2006.

Si vous avez besoin de créer une carte (géographique) personnalisée, vous pouvez désormais le faire gratuitement avec Google Maps. Présentation...

Vous allez lancer un nouveau site et vous aimeriez être sûr de ne rien oublier dans l'optimisation du référencement ? Alors lisez ces conseils...

Google a ajouté la possibilité de chercher des fichiers KML dans le logiciel Google Earth.

A part le PageRank, un des éléments les plus populaires de l'algorithme de Google était le Google Bombing. Etait, car depuis quelques jours les opérations de bombing ne marchent plus, les ingénieurs ayant développé un correctif algorithmique qui réussit à les désactiver. Comment ont-ils pu faire pour éviter une analyse manuelle ? Cela peut-il avoir un impact sur votre stratégie de netlinking ? Cet article tente de faire le point sur la question...

La terre vue par satellite : accord entre Google et Spot Image

Spot Image et Google viennent de signer un accord pour améliorer la résolution des images dans Google Earth, sur certaines zones du monde. Le spécialiste toulousain des images satellite Spot Image va fournir à Google des images du satellite Spot 5 à 2,5 m de résolution (1 pixel représente 2,5m au sol).

L'achat de lien est une des stratégies de liens connues pour optimiser son netlinking, c'est-à-dire le réseau de sites (de pages) qui pointent vers votre site. Voici quelques critères dont il vaut mieux tenir compte avant de se décider à acheter un lien.

CodeS-SourceS a un nouveau concurrent de taille : Google :-) Ce dernier lance un moteur de recherche de bouts de code source.

Google utilise de plus en plus dans son algorithme des facteurs liés à des indices de confiance (d'un site ou d'une page), comme par exemple le TrustRank. Mais qu'est-ce qui caractérise ces fameux sites ? Eléments de réponse...

Jusqu'à présent, Google ignorait totalement les feuilles de styles (CSS), mais on voit désormais des robots de Google venir les crawler. Quels sont les objectifs de Google ?

Commençons par présenter rapidement ce que sont les frames (ou cadres en français). Il s'agit d'un système qui permet d'afficher plusieurs pages indépendantes dans une même fenêtre de votre navigateur. De cette manière, une page peut être affichée en haut de la fenêtre du navigateur et une autre dans la partie basse, cette dernière contenant du texte que vous faites défiler avec l'ascenseur.

En général on utilise les frames pour afficher une zone de menu qui ne bouge pas et qui reste toujours visible à l'écran, tandis que le reste de la page est affiché dans une zone que l'on fait défiler. En cliquant sur les liens de la page du haut, seule la page du bas change, ce qui évite d'avoir à recharger la zone de menu.

Google est accrédité registrar par l'ICANN depuis février 2005, ce qui lui donne accès à de nombreuses informations sur les propriétaires des noms de domaine. Les utilise-t-il ?

Ce dossier reprend l'historique du moteur de recherche Exalead, un moteur de recherche français destiné aussi bien aux particuliers qu'aux entreprises.

Il fallait s'y attendre, après les petites annonces généralistes (Google Base), Google se lance désormais dans le domaine des rencontres avec son nouveau service Google Dating.

Qu'est ce que le spamreport et à quoi sert-il ? En quelques mots : c'est un formulaire assez simple qui a pour but (officiel) "d'aider google à améliorer la qualité de ses résultats". Voici quelques réflexions à son sujet...

Ils ont commencé avec un blog, et depuis ils en créent régulièrement un pour chaque service. Voici une liste quasi complète des blogs officiels de Google...

Google identifie les formes des mots (singulier/pluriel notamment)

Depuis longtemps, pour Google, les mots "patinoire" et "patinoires" sont différents, si bien que si on veut être positionné sur les 2 formes, il faut prévoir les 2 cas (par exemple créer 2 pages). Il est possible que ceci soit en train de changer, voici donc quelques pistes de réflexion.

Google proposait en option un lien pour supprimer un site des résultats

Yahoo le propose avec l'option "Bloquer", voilà donc Google qui a décidé de lancer une expérience en proposant cette fonctionnalité à un groupe restreint d'utilisateurs.

Baidu : voilà un nom qu'il faudra sans doute retenir. Ce moteur de recherche chinois a le vent en poupe, à tel point qu'il est surnommé le Google Chinois. Il a fait une entrée triomphale vendredi à la bourse américaine (Nasdaq). Le titre, fixé à l'ouverture à 27 dollars, a fini la journée à 122,54 dollars, ce qui représente une performance de près de 354 %, digne des heures de gloire de la bulle Internet... En cours de séance, le titre est même monté à 151,21 dollars.

TrustRank est à la fois le nom d'un algorithme cherchant à réduire le spam dans les moteurs de recherche et une marque déposée par Google en Mars 2005 (la marque est précisément Trust Rank en 2 mots). Le TrustRank est-il censé remplacer le fameux PageRank ? Difficile de savoir pour l'instant ce que Google veut faire du TrustRank. Voici en attendant d'y voir plus clair une description de l'algorithme du TrustRank.

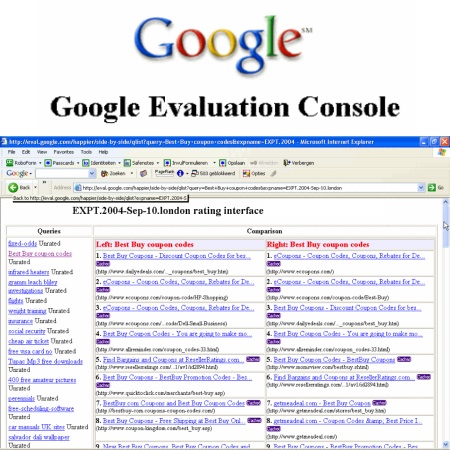

Nous connaissons tous les fameux laboratoires de Google... mais il semblerait qu'il y en ait d'autres tenus secrets. C'est en tout cas de cette façon que Henk van Ess présente des informations très intéressantes sur ce qui ressemble fort à un laboratoire d'évaluation (humaine) de l'algorithme de Google.

Sur Web Rank Info on parle beaucoup de référencement et des meilleures techniques pour améliorer le référencement de son site. Mais comment faire pour augmenter le nombre de visites autrement qu'en travaillant son référencement ? Cet article donne 10 pistes.

Pour être visible sur Google il faut être placé en haut et à gauche ! C'est ce qui vient de révéler une récente étude américaine. Les résultats de cette étude ne sont pas une surprise mais ils confirment ce que tous les spécialistes du e-marketing pensent.

Introduction en bourse de Google : chronologie complète expliquée

L'introduction en Bourse du célèbre moteur de recherche le 19 août 2004 a fait l'objet d'un procédé inhabituel par rapport aux autres entrées dans le système boursier. Découvrez cela avec des explications claires accessibles aux débutants !

Cet article décrit les grands principes de la Bourse Américaine avec d'une part les différentes unités de cette entité et d'autre part le processus d'achats et de ventes d'actions. Enfin, les étapes d'introduction en Bourse d'une société sont traitées plus en détail.

Saviez-vous que Google gérait un bac à sable ? C'est en tout cas le terme utilisé par les anglo-saxons (sandbox) pour désigner une nouvelle forme de filtrage ou de pénalité qui touche des sites sur Google.

Jeff Dean, ingénieur chez Google, a donné une conférence dans l'Université de Washington au cours de laquelle il a abordé plusieurs thèmes axés sur l'infrastructure technique de Google, qui sont résumés ici.

Certains arrivent à prendre la place d'autres sites dans les résultats de Google par la technique du détournement de page par redirection. Revenons sur quelques points de détails...

Découvrez le projet Opquast créé par Elie Sloïm dont l'ojectif est de fournir une liste des bonnes pratiques pour créer un site de qualité ou pour en évaluer un.

Dans le cas qui nous intéresse, la syndication de contenu correspond à la mise à disposition par un éditeur de site web d'une sorte de résumé des dernières mises à jour effectuées sur son site, de façon que d'autres éditeurs puissent intégrer ce résumé sur leur site ou le consulter à l'aide d'un logiciel spécifique (appelé "agrégateur" ou lecteur de flux).

L'exemple le plus courant est celui d'un site d'actualités qui propose sous la forme d'un fichier XML la liste des derniers messages d'actualité (titre + introduction + lien vers l'article). Les formats les plus courants sont RSS et Atom. On appelle ça un flux de syndication ou aussi un fil RSS / Atom.

Grosse surprise en ce 1er avril : Google annonce la prochaine disponibilité de Gmail, un service de mail gratuit offrant pas moins d'un giga octets d'espace de stockage, soit environ 200 à 500 fois plus que ses concurrents Yahoo et Microsoft, leaders dans le domaine. Annoncée un 1er avril, cette nouvelle a mis du temps avant d'être prise au sérieux, à tel point que David Krane, le porte-parole de Google a dû confirmer l'information diffusée dans le communiqué de presse. On peut néanmoins penser que la date a été soigneusement choisie par le service marketing de Google, qui signe là un bien joli coup en s'offrant une publicité mondiale, l'information étant relayée sur de très nombreux sites d'information.

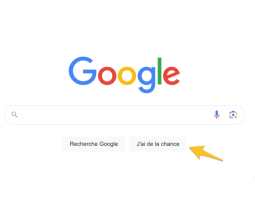

Le bouton J'ai de la chance (I'm Feeling Lucky en anglais) du formulaire de recherche de Google peut sembler déroutant à première vue. D'abord, il n'est pas évident de comprendre la première fois à quoi il sert. Ensuite, on peut se demander s'il est vraiment utile... Nous allons voir que la réponse est oui !

Si vous aussi vous trouvez que même Google est trop lent, essayez elgoog, le site miroir, vous en serez tout retourné !