Des réponses intelligentes aux requêtes des internautes

Ce qui impressionne le plus dans les annonces faites par Amit Singhal, c'est le fait que Google sache fournir des informations très poussées sur certains sujets dès lors qu'ils sont demandés par les internautes. On connait déjà les exemples de la météo, des matchs de foot ou des films de cinéma pour lesquels Google affiche des informations pertinentes dans une OneBox adapté. Désormais, quand un internaute tape le nom d'un lac (exemple "Lake Tahoe"), Google pourra afficher directement dans la page de résultats tout un tas d'informations comme l'emplacement géographique du lac, son altitude, sa température moyenne et son degré de salinité.

Google saura également répondre à des questions comme "Quels sont les 10 plus grands lacs de Californie ?".

Si vous avez déjà lu le livre "Google démocratie", j'imagine que vous devez y repenser. Les autres, je vous conseille fortement de lire cet excellent livre d'anticipation sur un univers qui vous concerne directement.

Avant d'envisager ce que tout ça signifie pour les référenceurs et éditeurs de sites, je vais tenter de vous expliquer le cheminement de Google pour arriver là.

Des mots aux syntagmes...

Historiquement, les moteurs de recherche se sont basés sur l'analyse des mots présents dans les documents indexés. Si un document contient les mots ou même l'expression demandée par l'internaute, alors il est sans doute pertinent. C'était l'époque d'Altavista, quand l'indice de densité était une notion utile (ce n'est plus du tout le cas).

Ensuite Google a rajouté une couche très importante : l'analyse des liens. Une page qui contient les bons mots c'est bien mais il peut y en avoir beaucoup : laquelle mettre en avant dans les résultats ? Réponse : les plus populaires, c'est-à-dire celles qui reçoivent le plus de citations (des liens).

Petit à petit, Google a progressé dans l'analyse linguistique : prise en compte des "petits mots" (stop words), reconnaissance des différentes formes des mots (singulier / pluriel et bien plus) puis des synonymes et autres relations entre les mots sémantiquement proches. N'hésitez pas à relire le dossier WRI qui explique comment Google reconnait les mots et celui qui détaille l'analyse des lexèmes.

Enfin, Google s'est mis à analyser les documents par syntagmes plutôt que par mots. Là aussi je vous encourage à lire le dossier WRI sur l'analyse des syntagmes faite par Google.

Mais comme l'a avoué récemment le big boss de l'algo, Google ne comprend toujours pas grand chose à nos contenus. C'est là que les entités nommées viennent en renfort.

La bataille des entité nommées

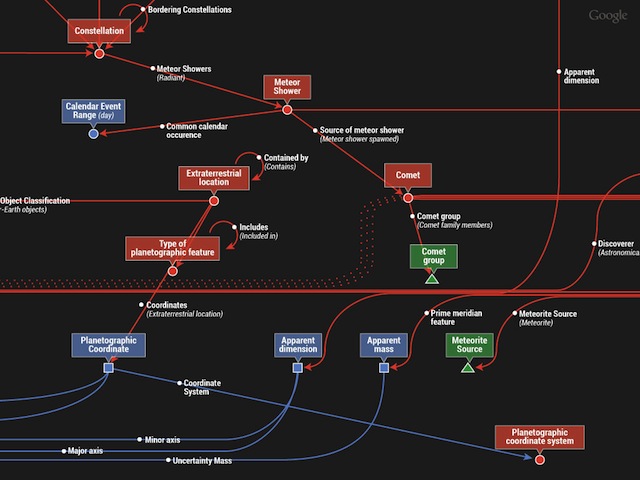

Concrètement et simplement, une entité nommée est une sorte d'objet textuel avec un nom bien identifié et une série de propriétés. On peut définir par exemple des entités pour des personnes, des lieux, des entreprises, des films, des livres et de très nombreux autres sujets.

En juillet 2010, en rachetant Metaweb et sa base de données de 12 millions d'entités nommées (named entities), Google a sans doute misé sur une pépite. En effet, à titre de comparaison, Wikipédia n'en contient que 3,5 millions (pour la langue anglaise).

Actuellement, le projet Freebase (développé par Metaweb) contient 22 millions d'entités, librement consultables y compris par une API.

En moins de 2 ans, Google aurait étendu sa base à 200 millions d'entités ! Pour cela, les dizaines d'ingénieurs qui travaillent sur le projet ont développé des "algorithmes d'extraction", c'est-à-dire des systèmes automatisés qui agrègent des données éparpillées sur le web.

En plus de ces algorithmes, Google aurait passé des accord avec des organisations et des agences gouvernementales pour augmenter sa base de connaissances. Par exemple, Google aurait accès à la CIA World Factbook, une base de connaissances à jour sur tout ce que l'on sait sur tous les pays dans le monde.

Si vous souhaitez mieux comprendre à quoi correspond une entité nommée et à quoi ça peut servir, regardez cette très bonne vidéo de vulgarisation :

Vous pouvez aussi consulter ces slides créés par Jean Véronis, un français :-)

Source : Jean Veronis - 2010 - Seo Campus

L'impact sur le référencement (et tout le search marketing)

L'affichage de résultats "intelligents" dans les SERP

Si Google investit autant pour ça, c'est que c'est stratégique pour l'entreprise. Quels sont donc les intérêts de Google ? J'en vois au moins 2 :

- renforcer l'avance technologique et la pertinence, pour fidéliser les internautes et éviter qu'ils commencent à regarder ailleurs ce qui se fait.

- garder l'internaute plus longtemps sur Google, ce qui est devenu plus dur qu'avant avec des concurrents comme Facebook ou Twitter. Evidemment, plus l'internaute reste sur les sites de Google (au lieu d'en consulter d'autres), plus Google a des chances que l'internaute finisse à un moment ou à un autre par cliquer sur une publicité AdWords...

Il s'agit d'une des mises à jour les plus importantes de l'histoire de Google. D'après Singhal, cela pourrait concerner entre 10% et 20% de toutes les recherches effectuées sur Google. A titre de comparaison, le filtre Panda aurait concerné 12% des recherches aux USA et entre 6% et 9% en France, avec les ravages que l'on connait pour de nombreux sites Internet.

Pour mieux comprendre pourquoi les entités nommées jouent un rôle important dans la recherche d'informations, il suffit par exemple de lire l'étude citée par Bill Slawski au moment du rachat de Metaweb par Google. Celle-ci indiquait que sur Bing, environ 20% à 30% des requêtes sont de simples entités nommées et 71% des requêtes contiennent une ou plusieurs entités nommées.

Qui pourrait être pénalisé par l'affichage de ces blocs de résultats avant les SERP ? C'est pour l'instant difficile de se prononcer car on ne connait ni les types de requêtes concernées ni le look de l'affichage de ces résultats spéciaux. Mais on peut penser que les sites qui ont le plus à craindre sont ceux qui fournissent une info si faible qu'elle peut être résumée en 1 ligne par Google en haut de résultats.

Une nouvelle façon d'analyser le contenu

Depuis la semaine dernière j'ai surtout vu des articles qui abordent ce "problème" (Google qui affiche des réponses avant les SERP), mais peu qui essaient de voir les choses de façon plus large. Certains ont quand même abordé une question clé : faut-il aider Google à extraire les entités nommées de nos sites ? Par exemple, faut-il utiliser le plus possible le formatage proposé par schema.org ? Pour ma part je pense que oui, mais c'est une question qui en soulève beaucoup d'autres.

Mais je pense que cette façon de développer un moteur de recherche va bien plus loin que savoir répondre à des questions sous forme de OneBox. C'est tout "simplement" pour Google une nouvelle façon d'analyser nos contenus, comme j'ai tenté de l'expliquer au début de cet article (analyse mot à mot, variations de mots, mots sémantiquement proches, groupes de mots et maintenant entités). En d'autres termes, Google essaie désormais de lister les entités présentes dans une page, leurs relations au sein de la page ou avec d'autres pages, leur co-occurrence avec d'autres entités, etc. En repérant également les entités dans les requêtes des internautes, Google procède désormais à une analyse globale par entités.

Si c'est bien vers cela que l'on se dirige, qu'est-ce que cela pourrait signifier pour ceux qui créent et optimisent des contenus ?

- J'imagine que si mon contenu n'est pas assez clair, Google peut échouer à détecter une entité pourtant présente, ce qui me sera néfaste.

- Si je ne fais que réécrire un contenu déjà publié ailleurs, que ce soit par un vulgaire content spinning ou par une réécriture plus poussée, ne vais-je pas être repéré comme étant une page qui publie les mêmes entités, dans le même ordre, avec les mêmes liens entre elles ? En d'autres termes, l'analyse par entités ne pourrait-elle pas redéfinir la notion de contenus dupliqués ?

- On pourrait alors estimer que ceux qui ont des contenus de qualité bien structurés seront gagnants.

Votre avis

Que pensez-vous de cette annonce ? Qu'est-ce que cela va changer pour vous, référenceur, webmarketer, webmaster, éditeur de site ?

J'attends vos réactions dans les commentaires ou bien dans la discussion du forum WRI "Google et son moteur de recherche sémantique"

Si vous avez des questions, posez-les dans le forum WebRankInfo.

Si vous préférez du consulting, j'en propose sur mon site WebRankExpert.

Toutes ses mises à jour, ne sont elles pas des manières pour décaler le keyword du SEO afin de mieux les vendre conté SEA. Je veux dire, si le moteur ne considère plus les requêtes par mot clé, les clients qui faisaient confiance au SEO vont se tourner vers le SEA d'où l'amélioration du chiffre d'affaire de Google.

GG veut dominer le monde. Il veut s'approprier l'internaute, s'approprier le web afin que l'internaute reste chez lui et clique sur les adwords.

Les autres sites, s'il veulent des visites, il n'y a plus qu'une chose à faire : payer... Le problème, c'est que si GG prend 75% de notre bénéf, et que l'état nous pompe le reste, que nous restera-t-il ? ? ?

Communauté Européenne ? Ouhouh ? Vous n'avez pas vu la position dominante ? A quand le prochain procès ?

Bonjour,

Merci d'avoir pris le temps de rédiger cette article qui résume parfaitement les entités.

Cependant, cela soulève une autre question, en utilisant le formatage prévue, (schema.org) il sera alors possible de "tricher" comme le font certain site notamment avec le nombre de votes ...

Et je pense qu'il sera encore plus compliqué de repérer les sites qui trichent.

Est-ce que l'on se dirige vers un Google où les meilleurs SEO seront ceux qui sauront encore plus qu'aujourd'hui, tromper Google ?

Ola !

Merci Olivier pour cet article, et pour ce site que je tiens pour référence (notamment afin de me décrotter sur le référencement de temps à autre).

Et aussi chers tous... dites... en lisant les premiers paragraphes de la documentation de schema.org, il ne vous est pas apparu clairement que google sémantique, c'est nous ?

Pour moi, si google sémantique, alors google capable de lire le contenu, l'analyser, agrémenter les entités, améliorer sa capacité de... discernement (!)

Là, c'est à nous de baliser en lui disant "ceci est cela". Vous trouvez pas ça dingo ? Il va falloir dire de ce que l'on a à dire dans nos pages, et ensuite le traduire pour la machine.

Exemple simple :

Event date:

May 8, 7:30pm

Je trouve cela tellement aberrant que s'en est comique. J'ai raté quelque chose ? Ou bien on va tous toucher un petit salaire de google pour l'aider à ranger sa [notre] chambre [web] ? :)

tisc0, artisan technologique

C'est plutôt effrayant qu'autre chose. Si google commence avec 20% des requêtes, il ne s’arrêtera pas là. Bientôt on n'aura plus besoin de ce rendre sur un autre site pour trouver une information

C'est le commencement de la fin ...

Ca sent l'abus de position dominante à plein nez. Nul doute que google va devoir faire face à de nombreux procès.

Cette évolution n'est pas un réel boulversement...seule une minorité de sites vont être touchés (ceux qui fournissent de l'information brute). Mais la plupart des requêtes ont besoin d'une réponse plus détaillée, les liens seront toujours consultés!

Un article vraiment complet. Google n'arrête plus son évolution.

J'avait déjà commencé à utiliser le formatage proposé par schema.org sans grande conviction.

Maintenant j'en vois une plus nette utilité.

Merci pour cet article. Il me vient par contre une question : est ce que ce nouveau système sera déployé en Anglais seulement ? Car en parlant de 200 millions d'entités nommées, on parle de l'espace anglophone, n'est ce pas ? En l'étendant au monde francophone on obtiendrait des volumes à traiter extrêmement importants...

@daming : on n'a pas plus d'informations mais en effet, la base d'entités nommées concerne sans doute beaucoup plus d'anglophones que d'autres langues. Peut-être que les traitements ne seront faits dans un premier temps qu'en anglais, comme ce fut le cas pour Panda (cf. chronologie de Panda).

En même temps les requêtes visées pour l'instant sont assez simples et comme dit dans l'article cela ne pourra marcher que pour des requêtes demandant une réponse simple. Les sites qui font beaucoup de trafic (sites sur les municipalités, les codes postaux, les numéros de téléphone, IPs...) ont à mon avis intérêt à se tourner vers un autre business.

Bonjour Olivier,

Au vu la multiplication des résultats (y compris les contenus de très faible qualité), Google n'est-il pas obligé d'orienter les utilisateurs dans les résultats de son moteur de recherche.

En fait, il ne se contente plus de proposer mais il guide l'internaute sur les requêtes données.

Finalement, il s'oriente vers plus de pertinence !

amicalement

A partir du moment où il ne comprend pas, ce n'est pas un peu bizarre d'en parler comme moteur sémantique ?

Les entités nommées et le reste sont une excellente rustine, mais ne résout pas le coeur du dilemme.

@Laurent : pour l'instant il ne comprend pas, d'où la nécessité de changer pour un système plus intelligent. Ce qui est décrit dans cet article sera-t-il vraiment en place et suffira-t-il ? Je n'en sais rien !

Entités nommées ou pas, mise en place du protocole de formattage de données schema ou pas, je pense que cela ne changera pas grand'chose sur le fond : les sites au contenu vraiment intéressant (sites très spécialisés sur la recherche ou des sujets d'experts) resteront toujours très bien référencés malgré un formattage ou un balisage déplorables.

Sur la forme (le business du référencement) c'est autre chose, car redire de 1 000 façons différentes la même chose ne va plus permettre d'asseoir une stratégie de visibilité pérenne.

Le soucis potentiel avec tout ça sera de ce maintenir à jour mais aussi de maintenir les sites, ce qui peut demander une grosse masse de travail. Ensuite il faudra voir ce que va faire réellement faire ce nouveau algorithme. Cela fait un moment qu'il est conseiller d'optimiser ses sites et de les rendre Google Friendly, est ce que ça va réellement changer la donne ?

Je n'ai malheureusement pas réussi à comprendre tous les principes de définitions des entités nommées mais si on regarde tout ça d'un peu plus haut, on se demande bien à quoi vont bien pouvoir encore servir les annuaires !

En effet, on y place les mêmes informations, spinnées ou réécrites, les informations sont en gros toujours les mêmes donc ne devraient à mon avis plus rien apporter en terme de référencement...

De plus; les "sniffers d'entités" mettront encore moins de temps à s'en rendre compte si on code nos annuaires selon schema.org...

Est-ce qu'on pourrait aussi penser que tous les noms de domaines qui seraient trop souvent liés au terme "référencement" passeraient pour des "tricheurs" et seraient ainsi déclassés par LE WEB de google ?

Si c'est le cas, je connais certains blogs qui vont perdre des commentateurs... ;-)

Je pensais au fait que je tombe sur ce genre de site par des recherches formulées comme une question ou une recherche d'information précise, qui peut être résumée en quelques mots, ou une phrase.

C'est ce qui me semblais être une partie de la problématique à laquelle google souhaite répondre dans sa OneBox.

Après je peux me tromper ou avoir mal compris; mais après lecture de l'article c'est ce qui m'est venu en tête directement.

C'est pour cela que je mettais comme exemple un processus xxxxx.exe (ce que je recherche de temps en temps pour comprendre un peu le fonctionnement du pc et les causes de ralentissement) et sur lequel je tombe régulièrement sur CCM ou autres sites du même genre.

Si derrière Google me donne l'information directement (le processus machin et tel truc) je n'aurai plus besoin d'aller sur le site, et donc une visite en moins.

Hum je pense que ceux qui ont le plus à craindre sont les sites qui drivent leur trafics sur de petites informations. Je pense par exemple à http://www.commentcamarche.net qui il me semble avait déjà eu des problèmes avec Panda.

Par exmple si il fini par répondre à "Qu'est ce que le processus hkcmd.exe" ...

Dans mon cas, avec des sites d'actu je voie mal Google réussir à expliquer en une phrases pourquoi l'euro connait un rebond à 14h ...

De toute façon si cela impacte entre 10 et 20% des recherches il y en a un paquet qui vont avoir mal. Surtout qu'a l'instar de Panda, ce n'est pas d'autre site qui en profiteront mais directement google.

@ Yorik : pourquoi CCM aurait-il + de pb que d'autres ? par ailleurs CCM a pu se débrouiller pour éviter de chuter avec Panda...

Ce que ça change pour nous (webdesigners/intégrateurs) ?

Exactement ce que j'annonce depuis la sortie de schema.org : Il va falloir penser structuration de contenu pour le rendre sémantique pour Google et les lecteurs diverses, donc se mettre en relation étroite avec les rédacteurs web et les responsables SEO... et du coup multiplier par 3 la charge et le temps de travail d'intégration !

On ne va plus avoir en tête que le terme "définition d’entités".

Au final, pour l'internaute, c'est top, puisque qu'il peut avoir la réponse à sa question encore plus vite et en moins de clics !

Mais pour le créateur de site, ça signifiera des coûts plus importants en optimisation de contenu !

Et pour l'intégrateur... des maux de tête ! ;)

"Moi aussi je pense qu'il faut vraiment utiliser le formatage de schema.org qui je pense est indispensable aujourd'hui."

Indispensable pour qui ? l'utilisateur ? ou Google qui l'exploitera pour éviter d'envoyer l'utilisateur ? (si oui je suis malheureusement dans la mauvaise barque)

Après les démarches de Google pour s'adapter au web, le web s'adapte à google, ce n'est pas forcement une façon de faire qui entre, pour moi, dans le cadre de l'excellence et la pertinence, mais peut être n'est ce que le fruit d'un constat d'échec.

"On pourrait alors estimer que ceux qui ont des contenus de qualité bien structurés seront gagnants."

Cette conclusion me laisse songeur car la structuration extrême amène à une forme de normalisation et de perte d'identité qui induit une forme de conformité pour ne pas dire de DC.

Ce qui me fait de plus en plus peur, c'est que Google se transforme en Facebook dans le sens où plus ça va et plus il veut contenir l'utilisateur dans ses propres services.

Avec la mise en avant de "search plus your world" dernièrement, je crains que le moteur sémantique ne soit qu'un pas de plus vers cette stratégie de position dominante !

Que va t-il se passer le jour où Google jugera qu'il n'a plus besoin des sites internet et qu'il est devenue LE web ?

J'ai l'impression que cela ressemble à un livre de science fiction ...

la sémantique va devenir indispensable . la grosse interrogation concerne l'utilisation par google des infos fournies par les webmasters . les one box vont apparaitre sur de plus en plus de requêtes . l'internaute aura sans nul doute une réponse rapide et efficace ( mais à quel prix ? des webmasters qui travaillent gratuitement pour google ? ) . google ressemble de plus en plus à un vampire ...

Encore une mis à jour qui "force" les utilisateurs a rester encore et toujours sur Google et non visiter les sites. Je pense que le principal objectif de Google est de se faire de l'argent avec l'Adwords.

Moi aussi je pense qu'il faut vraiment utiliser le formatage de schema.org qui je pense est indispensable aujourd'hui.

Excellent article de vulgarisation, Olivier. Merçi !

Grosso modo, le moteur devient une machine à interpéter des formes différentes et variées d'une même entité. Une grosse partie de la pertinence repose donc sur la qualité des dictionnaires utilisés, (ontologies, etc.), lesquels sont extrèmement ardus à réaliser.

J'ai peur que Google ne s'enferme dans trop peu de dico (pour faire court: il se restreindra à celui / ceux qui lui appartiennent / apprtiendront), et que par là-même il perde en pertinence.

On connaît le proverbe: "quand on a un marteau en main, tous les problèmes ressemblent à des têtes de clous"...

Je serai beaucoup plus rassuré si Google se "bornait" à son métier d'"interpréteur de dictionnaire" comme le font ses concurrents déjà engagés dans la sémantique.

Bonjour;

ce qui me dérange c'est beaucoup plus l'idée de la dépendance vers google c'est pas trop juste ça on doit donner libre à l'internaute de faire son choix.

En lisant cette article, la première peur est que moins d'internaute viendront sur nos site car ils auront déjà trouvé leur réponse sur google.

Ensuite effectivement, il faudra tenir compte des entités nommées et utiliser le formatage proposé par schema.org

Michaël

"utiliser le plus possible le formatage proposé par schema.org ? "

Je pense que cela va devenir nécessaire pour rester dans la course. Mais je me demande aussi si on ne va pas se tirer une balle dans le pied en formatant trop notre contenu.