Cet article fait partie des archives de WebRankInfo : certes, il est ancien, mais complet et détaillé pour son époque. Si vous cherchez d'autres informations, faites une recherche sur le site ou participez au forum. Contactez-moi si besoin.

Présentation de BERT

Qu'est-ce que BERT ?

BERT signifie Bidirectional Encoder Representations from Transformers. Cet algorithme a été diffusé en open source à la communauté scientifique en 2018. Le 25/10/2019, Pandu Nayak (vice président du moteur de recherche Google) a expliqué que BERT est utilisé sur Google.

A quoi sert BERT pour Google ?

La mise à jour BERT a pour objectif d'améliorer la compréhension des requêtes, afin de fournir des résultats plus pertinents notamment pour les requêtes formulées de manière naturelle. BERT permet également à Google de mieux comprendre les contenus qu'il indexe.

En gros, BERT permet à Google de s'adapter encore mieux qu'avant à la croissance des recherches vocales (ce qui ne se limite pas à celles faites avec des assistants, loin de là).

De façon plus détaillée, BERT sert aussi à Google pour les tâches suivantes (source) :

- comprendre la "cohésion textuelle" et désambiguïser des expressions ou phrases, en particulier lorsque des nuances polysémiques pourraient modifier le sens contextuel des mots.

- comprendre à quelles entités des pronoms font référence, ce qui est particulièrement utile dans les longs paragraphes avec plusieurs entités. Une applications concrètes : la génération automatique de featured snippets et la recherche vocale/conversationnelle.

- résoudre les problèmes d'homonymie

- déterminer à quelles entités nommées un texte fait référence

- prédire la phrase suivante

- répondre à des questions directement dans les SERP

A quoi sert BERT dans d'autres applications ?

Voici d'autres tâches pour lesquelles BERT excelle :

- questions réponses

- analyse des sentiments

- classification et analyse des sentiments

- appariement par paires de phrases et inférence du langage naturel

- identification de tweets offensants

- catégorisation par le biais de films de prédiction selon l'analyse des sentiments (IMDB)

- etc.

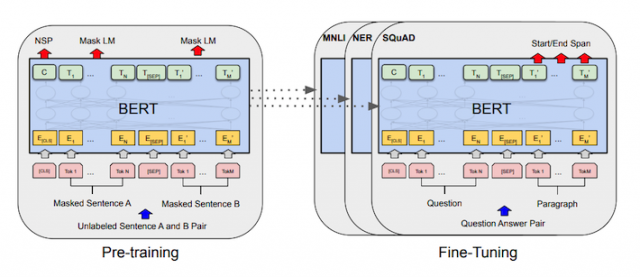

Comment fonctionne BERT ?

BERT est une technique de traitement du langage naturel (NLP), basée sur des réseaux de neurones. Google l'a diffusée en open source en novembre 2018.

Le terme transformers fait référence au principe d'analyse des mots en relation avec tous les autres dans la phrase, plutôt que les mots un par un. Les modèles BERT tiennent compte du contexte complet d'un mot en examinant les mots qui le précèdent et le suivent, ce qui est particulièrement utile pour comprendre l'intention derrière les requêtes de recherche.

BERT est particulièrement utile pour les requêtes plus longues, conversationnelles, ainsi que les recherches où les prépositions comme "pour" et "à" ont beaucoup d'importance sur le sens. Dans ces cas-là, le nouvel algo Bert sera en mesure de comprendre le contexte des mots dans votre requête.

Pour info, les Transformers ont permis d'importantes améliorations dans la traduction automatique, la modélisation linguistique et la génération de texte de haute qualité.

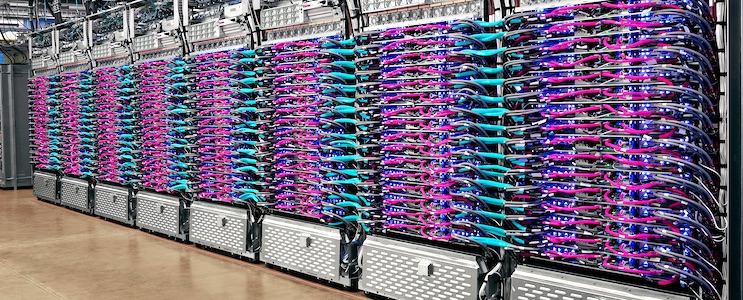

Pour faire tourner ces nouveaux algos de machine learning (IA), Google a pour la première fois utilisé des machines dédiées : des Cloud TPU. Les TPU (Tensor Processing Units) sont des circuits intégrés développés spécifiquement par Google et permettant d'accélérer les charges de travail de machine learning. Leur conception repose sur la vaste expérience de Google et sur son leadership en matière de machine learning. Cloud TPU permet d'exécuter des charges de travail de ML sur le matériel accélérateur des TPU de Google à l'aide de TensorFlow. (source).

Les dérivés de BERT les plus connus

Si les SEO ont découvert BERT en octobre 2019, les spécialistes du traitement du langage naturel le connaissent au moins depuis 2018. Un point majeur à noter est que BERT a été diffusé en open-source, ce qui a permis l'émergence d'une multitude de variantes et améliorations. D'ailleurs certains parlent de BERTologie (BERTology).

Voici les algorithmes basés sur BERT les plus connus :

- RoBERTa par Facebook, créé par Liu et al

- MT-DNN par Microsoft (détails)

- XLNet and ALBERT par Google et Toyota. Sorti en septembre 2019, ALBERT est déjà considéré comme le successeur de BERT, qu'il surpasse dans tous les domaines (notamment en termes de score sur SQuAD 2.0)

- BERT-mtl par IBM

- Google T5 par Google

- DistilBERT est une version plus petite, légère et rapide de BERT

- FastBERT est une version plus rapide de BERT

- CamemBERT est une version française développée par l'INRIA, dérivée de RoBERTa

Utilisation de BERT sur le moteur de recherche

Une particularité des systèmes sur lesquels BERT est conçu est que les avancées obtenues pour une langue (l'anglais pour démarrer) sont exploitables à d'autres langues. Par exemple, même au lancement avec seulement l'anglais, Google utilisait déjà BERT pour améliorer les featured snippets dans les "2 douzaines" de pays où ils sont disponibles, avec des progrès significatifs en coréen, hindi et portugais.

Google redit une fois de plus qu'environ 15% des requêtes faites par jour sont inédites (elles n'avaient jamais été faites sur Google).

Ben Gomes (Google) estime qu'en utilisant BERT sur le moteur de recherche, les utilisateurs devraient faire plus de recherches, ce qui apporterait plus de trafic vers tous les sites. (source)

Et donc plus de revenus publicitaires 💰💰💰

Il ajoute "Comme nous répondons à des questions plus exotiques, nous espérons que cela conduira les gens à poser de plus en plus de questions exotiques."

Impact de BERT sur le référencement

Selon Google, cet update est très important :

BERT est une amélioration significative de notre compréhension des requêtes, ce qui représente le plus grand bond en avant des cinq dernières années et l'un des plus grands bonds en avant de l'histoire du moteur de recherche.

Pandu Nayak (Google), le 25/10/2019

Comme Google l'avait déjà indiqué pour Rank Brain, "il n'est pas possible d'optimiser pour BERT".

Ne croyez tout de même pas que vous n'avez pas à tenir compte de ces avancées... A mon avis, pour des requêtes précises (constituées de nombreux mots), notamment celles formulées à l'oral, Google comprendra de façon bien plus précise ce que cherche l'internaute. Il fournira en résultats des pages qui répondent précisément aussi à cette demande. Donc si vos contenus sont superficiels ou imprécis, vous ne serez pas sélectionné pour figurer en tête des SERP. Même chose si votre contenu ne correspond pas assez bien à l'intention de l'internaute (que Google comprend de mieux en mieux).

Oui, BERT est déployé dans environ 70 langues dont le français, depuis le 9 décembre 2019. Le lancement avait eu lieu en octobre 2019 aux Etats-Unis pour les requêtes en anglais.

Selon Google, BERT a un impact sur 10% des recherches (ce chiffre date du lancement avec les requêtes effectuées en anglais aux USA). Cela concerne sans doute moins les requêtes à fort volume constituées de peu de mots.

A priori aucun ! Avec BERT, Google comprend mieux les formulations complexes dans les requêtes et les pages indexées, mais "travailler la longue traîne" n'est pas une "optimisation pour BERT".

Ce n'est pas du tout comme ça qu'il faut voir les choses ! De toutes façons, vous devez écrire de façon naturelle afin d'être bien compris par vos lecteurs. Et par Google, qui s'améliore à ce niveau avec BERT. Utilisez les stop words ou "petits mots" là où ils sont nécessaires.

Vous verrez sans doute bien moins que 10% d'impact, car les requêtes que vous surveillez ne sont sans doute pas formulées en langage naturel.

Selon Ben Gomes (vice président de Google Core Search), "des sites de niche pourraient mieux ressortir sur des questions de niche". A condition d'avoir un contenu vraiment à la hauteur !

Pour en savoir plus

Sources d'informations sur BERT

- l'annonce de Google sur son blog puis sur Twitter pour la généralisation à 70 langues

- présentation de BERT en novembre 2018

- le Github de Google sur BERT, en python

- la présentation de BERT en PDF par ses auteurs Jacob Devlin, Ming-Wei Chang, Kenton Lee et Kristina Toutanova

- liste des core updates de Google

Présentation vidéo

Faite par Danny Luo au cours des Toronto Deep Learning Series, le 6 novembre 2018 :

Si vous avez des questions, posez-les dans le forum WebRankInfo.

Si vous préférez du consulting, j'en propose sur mon site WebRankExpert.

Sur Searchengineland ils parlent d'une mise à jour de Bert le 7/8 novembre. Or cela a impacté les requêtes françaises.

C'est également la plus grosse mise à jour au niveau de mes clients de l'année. Serait-ce le lancement de Bert en France ?

Je doute que ce soit BERT et même que Search Engine Land l'ait dit. Quelle est l'URL de leur article ?

Rien d''officiel, mais ils se posent sérieusement la question dans cet article :

https://www.searchenginejournal.com/google-update-response/

OK donc c'est Search Engine Journal, pas Land...

Pour ma part, je ne crois pas que ce soit lié à BERT, car l'impact de l'update du 8 novembre fut très fort (ce qui n'est pas attendu avec BERT) et toucha apparemment le monde entier et de nombreuses langues (alors que BERT n'est pas encore déployé à ce niveau).

Vers la fin de l'article, il manque le mot compte dans la phrase "Ne croyez tout de même pas que vous n’avez pas à tenir de ces avancées"

C'est avec des phrases comme ça qu'on obtient 15% de recherches inédites par jour :p

Je pense, que cette algorithme ait une forte dimension machine learning, surtout au début de la release : bien que le modèle ait été déjà lance' sur le corpus de Wikipedia, ils doivent le mettre a' la preuve de Google Search.

Pour ce qui est des impacts SEO… a’ mon avis il n’y en aura pas beaucoup. Dans le sens qu’on ne pourra pas maitriser grand-chose du cote’ seo.

Cet algorithme est évidemment un pas en avant dans la stratégie de Google que consiste à « sortir » du terrain « moteur de recherche » pour devenir a’ touts égards un « moteur de réponse » et de recommandations.

Pour moi, il y aura de moins a’ moins de trafic pour les sites (c’est déjà le cas aujourd’hui) et de plus en plus de « Answers box » et reponses vocales, voire carrément la disparition/occultation des listes de résultats…

Une autre possibilité ce serait que plusieurs algos coexistent : BERT pour les « Reponses » et…beaucoup plus en bas, un autre pour les listes de résultats

"...to create state-of-the-art models for a wide range of tasks, such as question answering and language inference"

http://arxiv.org/pdf/1810.04805

Frank, es-tu un robot ? Ou utilise tu un traducteur? En tout cas, tu devrais te relire : c'est insoutenable ! [mais merci pour le lien ;) ! ]

BERT est une techno disponible depuis plus d'un an... je ne suis pas convaincu que Google l'utilise. AlBERT est son évolution la plus prometteuse.

ALBERT représente le nouvel état de l'art dans ce domaine sur plusieurs points (et notamment sur l'efficacité de la gestion des paramètres du/des modèles).

Google a rendu public le 21 octobre dernier (tiens donc!) une partie des sources ici : https://github.com/google-research/google-research/tree/master/albert

Qu'est-ce que ça signifie concrètement pour les SEO ?

Les mots-clés sont morts ! Je suis de plus en plus convaincu que les SEO doivent optimiser pour les sujets (topics) et non plus pour les mots-clés. En tout cas, c'est ce point que l'on défend chez SEOQuantum :)

C'est aussi le signal que la recherche vocale commence a prendre le pas sur la recherche manuelle, et n'est-ce pas notre avenir maintenant que les ordinateurs commencent à parler "intelligemment" ?

Vu que Google a atteint la suprématie quantique (avec un ordinateur calculant 10 000 fois plus vite que le plus puissant des gros calculateurs actuel), tout ces facteurs prises en compte, avec le futur débit 5G, l'arrivée de BERT semble logique.

Correctif : l'ordinateur quantique de Google a été 1,5 milliard de fois plus rapide...

Bonjour,

Jusqu'à présent les prépositions n'étaient pas considérées comme un mot clé pertinent. Ils sont alors souvent absents des urls pour laisser la place aux mots clés plus stratégiques.

Avec Bert, faudra t-il en tenir compte et indiquer le sens des mots clés dans l'url en utilisant les prépositions ?

Google n'ignorait pas les prépositions ! Par contre avec BERT il sait mieux comprendre les phrases qui en contiennent plusieurs, ce qui rend l'analyse bien plus complexe.

Sinon, concernant les mots-clés dans l'URL c'est vraiment très peu important, donc je ne vois pas pourquoi qui faudrait changer ses habitudes.

Bonjour,

Dans la présentation ci-dessus, tu évoques l'importance accrue donnée aux prépositions comme "pour" et "pour". Le texte anglais de Google dit "prepositions like 'for' and 'to' ". Donc, je dirais plutôt les prépositions "pour" et "à" (ou "vers").

En fait, si je comprends bien, ce sont les diverses prépositions qui sont davantage prises en compte, les deux prépositions citées par Google ne l'étant qu'à titre purement exemplatif.

Merci, j'ai corrigé mon erreur.

Je pense que ça va au-delà d'une meilleure prise en compte des prépositions, il y a certainement d'autres cas où l'ordre des mots peut totalement changer le sens global